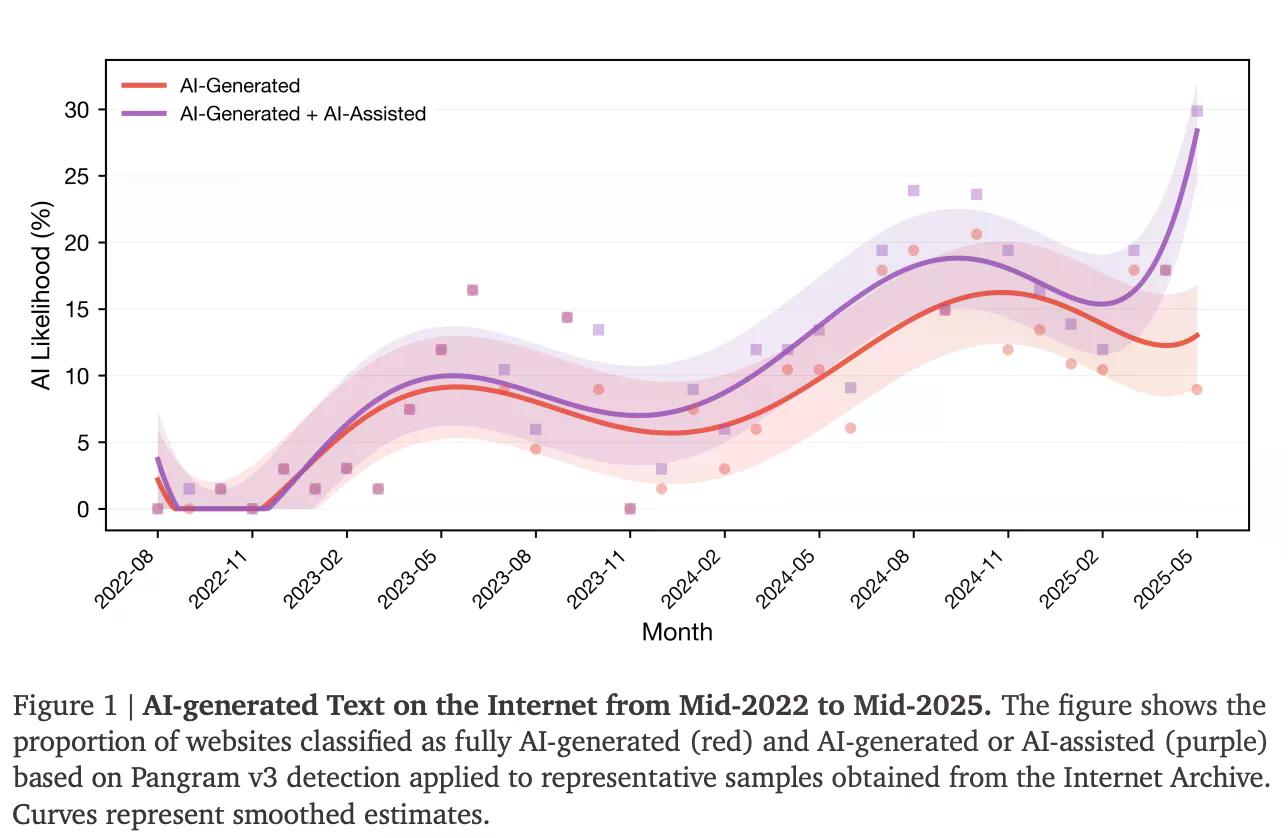

یک مطالعه جدید رقمی برای میزان محتوای تولید شده توسط هوش مصنوعی در اینترنت ارائه کرده است: ۳۵ درصد. این سهم وبسایتهای تازه منتشر شده است که تا اواسط سال ۲۰۲۵ توسط هوش مصنوعی تولید شده یا با کمک هوش مصنوعی دستهبندی شدهاند، طبق تحقیقات دانشگاه استنفورد، امپریال کالج لندن، و آرشیو اینترنت. این رقم اساساً پیش از راهاندازی ChatGPT در نوامبر ۲۰۲۲، صفر بود.

جوناس دولژال، محقق امپریال کالج لندن و یکی از نویسندگان این مقاله، به ۴۰۴ مدیا گفت: «سرعت بالای تسخیر وب توسط هوش مصنوعی برای من حیرتانگیز است.» او افزود: «پس از دههها شکلدهی توسط انسانها، بخش قابل توجهی از اینترنت تنها در سه سال توسط هوش مصنوعی تعریف شده است.»

این مطالعه با عنوان «تأثیر متن تولید شده توسط هوش مصنوعی بر اینترنت»، بر اساس ۳۳ ماه اسنپشات وبسایتها از «ماشین بازگشت» آرشیو اینترنت انجام شده و از یک تشخیصدهنده متن هوش مصنوعی به نام Pangram v3 برای دستهبندی هر صفحه استفاده کرده است.

آسیبهای تایید شده: جوّ، نه واقعیت

محققان شش فرضیه درباره تأثیر محتوای هوش مصنوعی بر وب را آزمایش کردند. تنها دو مورد از آنها در بررسی دادهها تأیید شد.

اولین: ما در حال تبدیل شدن به انبوهی از NPCهای (شخصیتهای غیرقابل بازی) کندذهن هستیم که به یک شکل عمل میکنند... یا به عبارت علمیتر، وب در حال از دست دادن تنوع معنایی خود است.

وبسایتهای تولید شده توسط هوش مصنوعی، امتیازات شباهت معنایی زوجی ۳۳ درصد بالاتر از وبسایتهای نوشته شده توسط انسان نشان دادند. ایدههای مشابه به روشهای تقریباً یکسان بارها و بارها بیان میشوند.

این مقاله نشان میدهد که پنجره اورتون آنلاین ممکن است در حال تنگ شدن باشد، نه از طریق سانسور یا کمپینهای هماهنگ، بلکه به این دلیل که مدلهای زبانی خروجیهایی را بهینه میکنند که به توزیع دادههای آموزشی آنها نزدیک است.

دومین: وب به طور تهاجمی در حال شادتر شدن است.

محتوای هوش مصنوعی امتیازات احساسی مثبت بیش از ۱۰۷ درصد بالاتر از محتوای انسانی نشان داد. محققان این موضوع را به تمایلات تملقآمیز و مستند LLMها (مدلهای زبانی بزرگ) مرتبط میدانند – که بر اساس سیگنالهای تأیید انسانی آموزش دیدهاند، متنی تولید میکنند که پاکیزه، بدون اصطکاک و به طور بیوقفه خوشبینانه به نظر میرسد.

اینترنتی که غرق در محتوای شاد و یکسان شده است، ممکن است مخالفتهای انسانی را در مقیاس وسیع، بدون نیاز به دخالت کسی، به حاشیه براند.

علیرغم باور عمومی گسترده، این مطالعه هیچ مدرک آماری قابل توجهی مبنی بر اینکه محتوای هوش مصنوعی دقت واقعی اینترنت را کاهش میدهد، پیدا نکرد. محققان هیچ همبستگی معناداری بین شیوع هوش مصنوعی و نرخ خطای واقعی نیافتند.

فرضیه تکفرهنگ سبکی – یعنی مسطح کردن صداهای فردی توسط هوش مصنوعی به یک سبک عمومی و یکنواخت – با قویترین باور پاسخدهندگان (۸۳% موافق بودند) همراه بود. دادهها این موضوع را تأیید نکردند. تحلیل در سطح کاراکتر هیچ افزایش آماری قابل توجهی در یکنواختی سبکی مرتبط با شیوع هوش مصنوعی نشان نداد.

پیامدهای گستردهتر فراتر از کیفیت گفتمان است. با فراگیر شدن ۳۵ درصدی هوش مصنوعی، خطر نظری فروپاشی مدل – جایی که مدلهای آینده پس از آموزش بر روی دادههای تولید شده توسط هوش مصنوعی، کیفیت خود را از دست میدهند – از یک نگرانی آکادمیک به یک واقعیت تجربی تغییر میکند. مدلهای پایه آینده که بر روی خزیدنهای وب معاصر آموزش میبینند، ناگزیر دادههایی را جذب خواهند کرد که به طور قابل توجهی توسط هوش مصنوعی تولید شده و به وضوح از نظر معنایی تنوع کمتری دارند.

این تیم اکنون با آرشیو اینترنت همکاری میکند تا این مطالعه را به یک ابزار نظارت مستمر و زنده تبدیل کند و سهم هوش مصنوعی از وب را به صورت بیدرنگ، به جای یک اسنپشات یکباره، ردیابی کند.

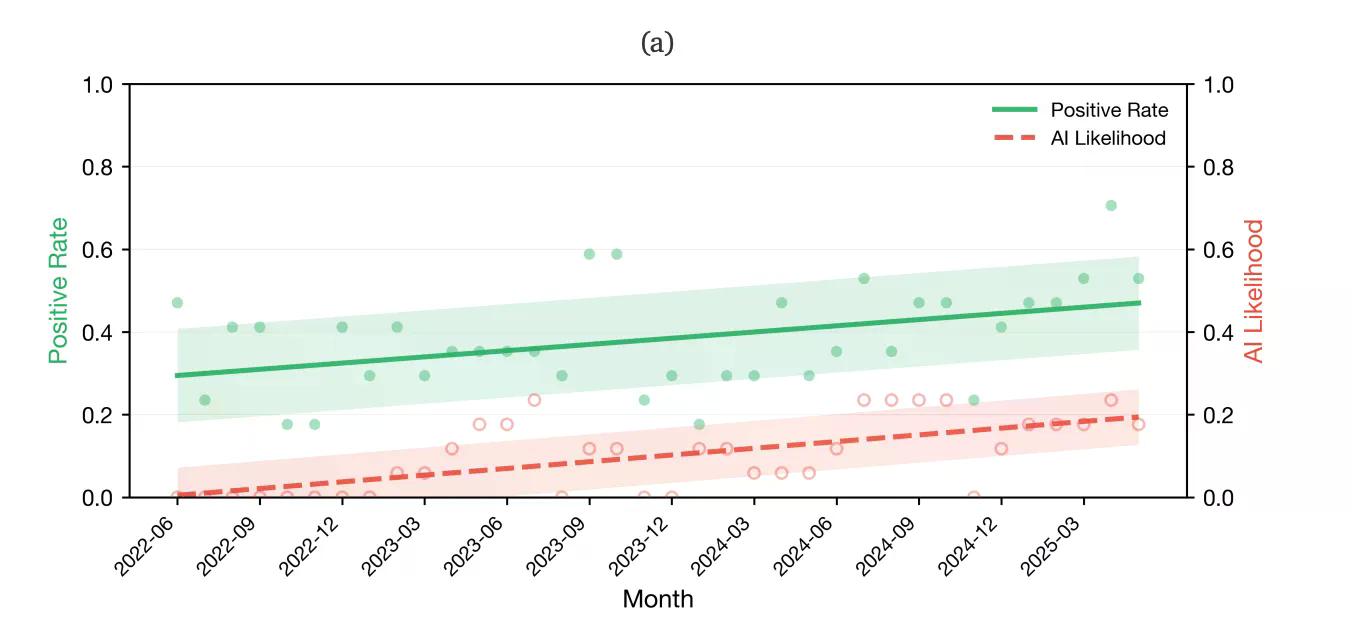

یک نظرسنجی آمریکایی که در کنار این مطالعه انجام شد، نشان داد که بیشتر آمریکاییها از قبل به هر شش فرضیه منفی، از جمله مواردی که دادهها پشتیبانی نمیکنند، اعتقاد دارند. افرادی که به ندرت از هوش مصنوعی استفاده میکنند، ۱۲% بیشتر از کاربران مکرر به آسیبها اعتقاد داشتند. طرفداران نظریه اینترنت مرده، با دادهها روبرو شوید: اینترنت نمرده است، اما ۳۵ درصد از محتوای جدید آن احتمالاً به نوعی محتوای زامبی است.